Yapay zeka görüntü üretiminin vaadi, sizi sürekli bulut abonelikleri, anlaşılmaz kredi sistemleri ve adeta kendi akılları varmış gibi davranan içerik filtrelerinin yarattığı sinir bozucu bir ağın içine mi hapsetti? Özellikle kontrol, gizlilik ihtiyacınız olduğunda veya pikselleri uzaktaki sunucular aracılığıyla itmenin getirdiği tekrarlayan maliyetlerden kaçınmak istediğinizde bu durum sıkça karşılaşılan bir darboğaz haline geliyor.

Şimdi, bu düğümü çözecek önemli bir gelişme müjdeliyor. Docker Model Runner, Open WebUI ile birlikte tam teşekküllü, yerel ve gizlilik odaklı bir görüntü üretimi hattı oluşturmayı mümkün kılıyor. Bu sadece teorik bir olasılık değil; bulut bağımlılıklarını tamamen ortadan kaldıran, bireyler ve geliştiriciler için çekici bir alternatif sunan pratik ve uygulanabilir bir çözüm.

Yerel Kontrolün Cazibesi

Görüntü üretimi modellerini yerel olarak çalıştırmak yeni bir konsept olmasa da, bu Docker destekli kurulumun sunduğu entegrasyon kolaylığı ve cilalı kullanıcı deneyimi dikkate değer bir ilerleme. Geleneksel olarak Stable Diffusion gibi karmaşık modeller için yerel çıkarım (inference) ayarlamak, Python ortamlarıyla, bağımlılık cehennemiyle ve genellikle önemli GPU yapılandırma engelleriyle mücadele etmeyi gerektiriyordu. Burada izlenen yaklaşım bu süreci dramatik bir şekilde kolaylaştırıyor.

Docker’ın konteynerleştirmesinden yararlanarak, hem çıkarım motoru hem de kullanıcı arayüzü için karmaşık bağımlılıklar ve çalışma zamanı ortamları düzgünce paketlenip yönetiliyor. Bu, yalnızca bir komut satırı aracıyla yetinmediğiniz, çevrimdışı çalışan bir yapay zeka görüntü üretimi için masaüstü düzeyinde bir uygulama elde ettiğiniz anlamına geliyor.

Gerçekte Nasıl Çalışıyor: Teknik Bir Döküm

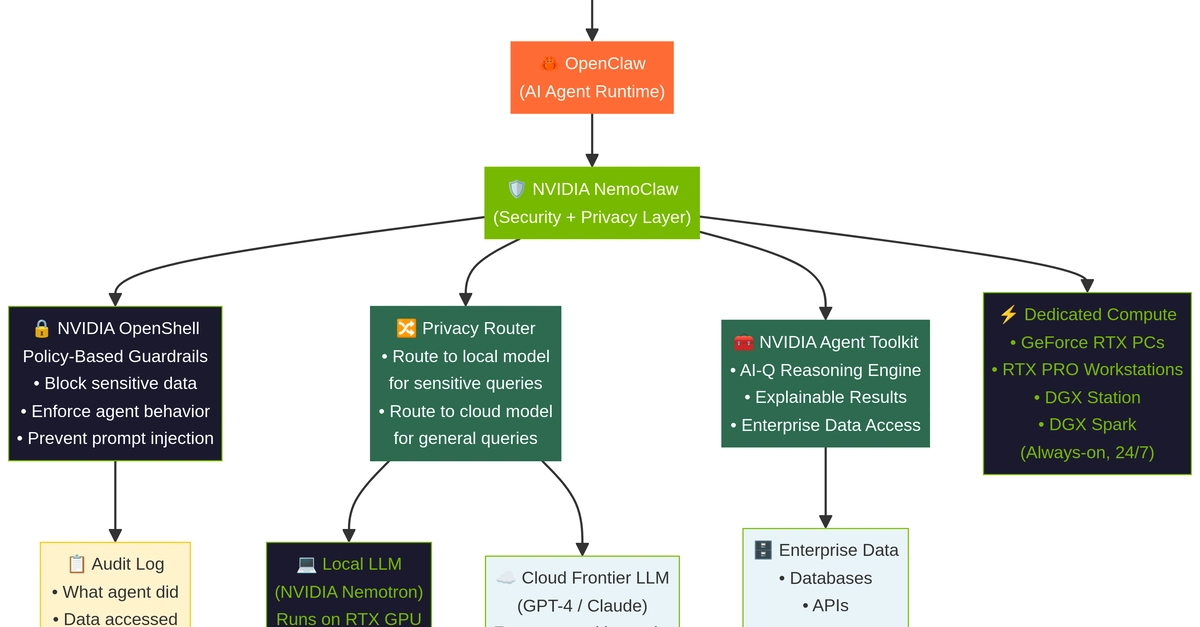

Özünde, Docker Model Runner gelişmiş bir orkestratör görevi görüyor. Yapay zeka modellerini indirme gibi ağır işleri üstleniyor — bunları DDUF (Diffusers Unified Format) adı verilen bir formatta paketliyor — ve çıkarım yaşam döngülerini yönetiyor. Buradaki temel yenilik, %100 OpenAI uyumlu bir API sunabilmesi. LLM’ler için popüler bir sohbet arayüzü olan Open WebUI’nin zaten bu dili konuşacak şekilde tasarlandığı düşünülürse bu kritik bir özellik.

Bunu şöyle düşünün: Docker Model Runner çevirmen ve makine dairesi. Stable Diffusion modelini (veya diğerlerini) çekiyor, hesaplamaya hazır olduğundan emin oluyor ve sonra yeteneklerini, özel bir çeviri katmanına ihtiyaç duymadan Open WebUI’nin anlayabileceği bir API aracılığıyla sunuyor. Bu akıllı mimari seçim, entegrasyonu bu kadar akıcı hale getiriyor.

Adım 1: Modeli Eve Getirme

Görüntü üretimi modelini yerel sisteminize almak şaşırtıcı derecede basit. Tek bir docker model pull komutu gerekli bileşenleri çekiyor. Örneğin, stable-diffusion modeli kolayca bulunabiliyor.

docker model pull stable-diffusion

Bu komut, modelin yapıtını indirir ve bu daha sonra yerel olarak saklanır. Boyutunu ve formatını doğrulayarak ayrıntılarını inceleyebilirsiniz; bu genellikle gerekli tüm model ağırlıklarını ve yapılandırmalarını içeren bir DDUF dosyasıdır.

docker model inspect stable-diffusion

Bu, modelin temiz bir temsilini gösterir; kimliği, etiketleri, oluşturma zaman damgası ve kritik olarak formatı ve boyutu. DDUF formatı, taşınabilirlik için tasarlanmıştır; temelde bir difüzyon modelinin bileşenlerini tek, yönetilebilir bir dosyaya paketler. Docker Model Runner bunu nasıl açıp kullanacağını biliyor.

Adım 2: Arayüzü Başlatma

İşte sihrin gerçekten gerçekleştiği yer burası. Docker Model Runner, özellikle Open WebUI için bir launch komutu içeriyor. docker model launch openwebui komutunu çalıştırmak gerekli konteynerleri başlatır, ağ yapılandırmasını yapar ve WebUI’yi tarayıcınız üzerinden erişilebilir hale getirir.

docker model launch openwebui

Arka planda bu komut bir docker run komutunu düzenler. UI’nin portunu (3000) ana makineye eşler ve kritik olarak OPENAI_API_BASE ve OPENAI_BASE_URL gibi ortam değişkenlerini, özel bir Docker dahili ana bilgisayar adına (model-runner.docker.internal) işaret edecek şekilde ayarlar. Bu ana bilgisayar adı, konteynerlerin karmaşık port yönlendirme olmadan ana makinede çalışan Model Runner hizmetiyle iletişim kurmasına olanak tanır.

WebUI’yi arka planda çalışır durumda tutmak isterseniz, --detach bayrağı yardımcınız olacaktır. Hizmetlerini yapılandırma dosyaları aracılığıyla yönetmeyi tercih edenler için, daha bildirimsel bir yaklaşım sunan bir Docker Compose kurulumu da mevcuttur.

Adım 3: Open WebUI’de Görüntü Oluşturmayı Yapılandırma

Open WebUI çalıştığında ve yerel hesabınızı oluşturduğunuzda (içiniz rahat olsun, tüm veriler çevrimdışı kalır), görüntü oluşturmayı etkinleştirmek için yönetici ayarlarına hızlı bir ziyaret yeterlidir. /admin/settings/images yoluna gitmek basit bir form ortaya çıkarır.

Burada özelliği etkinleştirir ve modelin API uç noktasını belirtirsiniz. Model adı olarak stable-diffusion ve API URL’si olarak http://model-runner.docker.internal/engines/diffusers/v1 gireceksiniz. UI’nin formu tarafından sahte bir API anahtarı da gereklidir, ancak yerel bir hizmet için kimlik doğrulama gerekmediğinden, boş olmayan herhangi bir dize yeterli olacaktır.

Adım 4: Metinsel Zekayı Ekleme

Open WebUI sadece görüntüler için değil; tam teşekküllü bir sohbet arayüzüdür ve konuşma komutlarına dayalı görüntüler oluşturma yeteneği önemli bir özelliktir. Bunu etkinleştirmek için yerel olarak çalışan bir dil modeline (LLM) de ihtiyacınız vardır. Docker Model Runner, daha düşük kaynaklı sistemler için smollm2 veya daha yetenekli makineler ve daha nüanslı yaratıcı çıktılar için gpt-oss gibi çeşitli LLM’leri çekmeyi destekler.

# Hafif seçenek — hemen hemen her makinede çalışır

docker model pull smollm2

# Önerilen — daha yetenekli, yaratıcı komutları anlamada daha iyi

docker model pull gpt-oss

Bu modeller otomatik olarak Open WebUI’nin model seçicisinde görünür ve aralarında sorunsuz geçiş yapmanıza olanak tanır. LLM daha sonra sohbetteki istekleri yerine getirmek için yapılandırılmış görüntü oluşturma uç noktasını kullanır.

Piyasa Dinamikleri: Neden Önemli?

Bu sadece teknik bir kolaylık değil; bireylerin ve daha küçük kuruluşların güçlü yapay zeka yeteneklerine nasıl erişebileceğinde somut bir değişimi temsil ediyor. Yıllarca anlatı, büyük bulut sağlayıcıları ve onların özel API’leri tarafından domine edildi. Kullanışlı olsalar da, bu model maliyet, veri gizliliği ve satıcıya bağımlılıkla ilgili önemli engeller yaratıyor. Yerel donanımın artan karmaşıklığı, model optimizasyonu ve konteynerleştirmedeki gelişmelerle birlikte, nihayet bu gelişmiş araçları demokratikleştiriyor.

Bağımsız sanatçılar, araştırmacılar ve geliştiriciler için çıkarımları düşünün. Artık sürekli artan bulut faturaları endişesi olmadan yapay zeka tarafından üretilen içerikleri deneyebilir, yineleyebilir ve dağıtabilirler. Gizlilik yönü de aynı derecede cazip; hassas proje verileri veya kişisel yaratıcı çalışma hiçbir zaman kullanıcının makinesinden ayrılmaz. Yapay zeka araçları üzerindeki bu kendi egemenliği, merkezi bulut paradigmasına güçlü bir karşı anlatı sunuyor.

Buradaki benzersiz görüşüm: Birçoğu yerel yapay zekayı maliyet tasarrufu için överken, asıl devrim çevrimdışı yaratıcılık ve Ar-Ge’nin etkinleştirilmesidir. İnternet bağlantısının güvenilmez olduğu veya veri oturma yasalarının sıkı olduğu senaryolar için bu yaklaşım sadece tercih edilebilir değil, aynı zamanda zorunlu hale geliyor. İnternet açıkken çalışan bir araç ile siz çalıştırmak istediğinizde çalışan bir araç arasındaki fark budur.

Gerçekten Bulut Hizmetlerinden Daha mı İyi?

Birçok kullanım durumu için evet. Ana avantajlar açık: tekrarlayan maliyet yok, tam veri gizliliği ve çevrimdışı çalışabilme yeteneği. Geriye ne kalıyor? Hızlı üretim hızlarına ulaşmak için yeterli yerel donanıma, özellikle de yetenekli bir GPU’ya ihtiyacınız olacak. İhtiyaçlarınız ara sıra veya deneysel ise, giriş bariyeri basit bir bulut kaydından daha yüksek görünebilir. Ancak, tutarlı kullanım, profesyonel iş akışları veya veriler üzerinde sıkı kontrol gerektiren herhangi bir durum için, yerel Docker Model Runner ve Open WebUI çözümü çekici bir öneri sunuyor. Yapay zeka görüntü üretimini tükettiğiniz bir hizmetten komuta ettiğiniz bir araca dönüştürüyor.

Geliştiriciler İçin Neden Önemli?

Geliştiriciler, bulut harcamaları yapmadan deneyler için bir sanal alan kazanır. Yapay zeka görüntü üretimini yerel geliştirme iş akışlarına entegre edebilir, yeni komut istemi mühendisliği tekniklerini test edebilir ve harici API’lere güvenmeden bu modelleri kullanan uygulamalar oluşturabilirler. OpenAI uyumlu API, mevcut araçlar ve OpenAI’nin ekosistemini destekleyen çerçevelerle entegrasyonu basitleştiren önemli bir nimettir. Bu, geliştiricinin makinesinde doğrudan gelişmiş yapay zeka destekli özellikler oluşturma giriş engelini düşürüyor.

🧬 İlgili İçgörüler

- Daha fazlasını okuyun: Scrapy Yöneticisi Yapay Zeka Kazıyıcıları Hakkında Bombalar Bırakıyor: Kod Kolay, Sayfalar Karşı Koyuyor

- Daha fazlasını okuyun: HIPAA 2026: Hastaneler İçin Şifreleme Zorunlu, Esneklik Bitti

Sıkça Sorulan Sorular

Docker Model Runner tam olarak ne yapıyor? Docker Model Runner, yapay zeka modellerinin indirilmesini ve yaşam döngüsünü yönetir, bunları Open WebUI gibi uyumlu uygulamaların kullanımı için OpenAI uyumlu bir API aracılığıyla sunar. Yerel, çevrimdışı yapay zeka çıkarımını etkinleştirir.

Bulut görüntü üretimi aboneliklerimin yerini alacak mı? Özellikle maliyet, gizlilik veya çevrimdışı yeteneğe öncelik veren birçok kullanıcı için evet. Ancak bulut hizmetleri yine de kolaylık, daha yüksek ölçeklenebilirlik veya henüz yerel dağıtım için mevcut olmayan en yeni modellere erişim sunabilir.

Yerel yapay zeka görüntü üretimi için ne kadar RAM’e ihtiyacım var? Küçük modeller için yaklaşık 8 GB RAM önerilir, ancak daha büyük, daha yetenekli modeller için daha fazlası her zaman daha iyidir. Özel bir GPU performansı önemli ölçüde artırır.