Ваш ноутбук на Intel теперь тянет LLM — без NVIDIA и бенчмарки

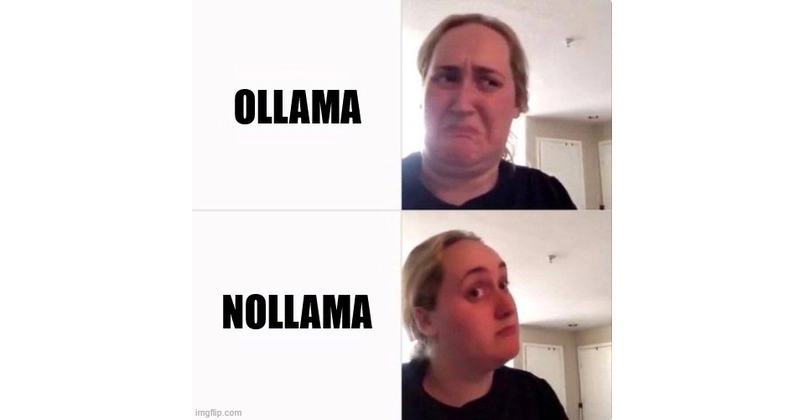

Все думали, что LLM требуют NVIDIA или облачных серверов. NoLlama переворачивает всё с ног на голову — NPU в вашем Intel-ноутбуке превращается в зверя для локального ИИ, без проблем стримит чат и модели для зрения.

⚡ Key Takeaways

- NoLlama без хлопот запускает LLM на NPU, iGPU, дискретном GPU и CPU Intel — без ручной настройки. 𝕏

- Автоопределение железа, поддержка API OpenAI/Ollama, стриминг чата и моделей зрения — всё локально. 𝕏

- Идеально для чувствительных данных (GDPR, медицина, юрка) — без утечек в облако, проходит любой аудит. 𝕏

- Бенчмарки: NPU ~5 ток/с на 8B, iGPU 15–20 ток/с на VLMs; эффективность важнее грубой скорости. 𝕏

- Прогноз: сдвиг на NPU как ARM-революция в смартфонах — edge AI войдёт в мейнстрим к 2026-му. 𝕏

Worth sharing?

Get the best Open Source stories of the week in your inbox — no noise, no spam.

Originally reported by Dev.to