Оказывается, 47% разработчиков сообщают о трудностях при тестировании сложной серверной логики. Это поразительная цифра, намекающая на повсеместную проблему в архитектуре наших систем. Часто виновато не отсутствие навыков, а отсутствие по-настоящему модульного дизайна. Именно здесь Паттерн Pipeline проявляет себя во всей красе, предлагая более чистый и поддерживаемый способ создания Go-приложений.

Вспомните, как в последний раз вы боролись с громоздкой Go-функцией, пытаясь выделить отдельный фрагмент функциональности для модульного теста. Неприятно, не так ли? Это частая картина, и во многом симптом тесно связанных зависимостями участков кода, где один этап операции неразрывно связан со следующим.

Спутанный клубок: жизнь без Pipeline

Рассмотрим типичную серверную задачу, например, парсинг объявлений о вакансиях с различных сайтов. Процесс обычно включает несколько distinct шагов: получение сырых данных, их очистка (нормализация), присвоение оценок релевантности и, наконец, сохранение в базе данных. В традиционном, ‘монолитном’ подходе все эти шаги могут быть упиханы в один цикл.

for _, raw := range rawJobs {

// normalize

raw.Title = strings.TrimSpace(raw.Title)

raw.Location = strings.ReplaceAll(raw.Location, "NYC", "New York")

// score

score := 0

for _, keyword := range keywords {

if strings.Contains(raw.Title, keyword) {

score++

}

}

// save

s.Repo.Create(raw.Title, raw.Location, score)

}

На первый взгляд это может показаться простым, но это благодатная почва для проблем. Видимость этапов? Забудьте. Вам придется прочитать весь блок, чтобы понять, где заканчивается нормализация и начинается скоринг. Тестирование превращается в упражнение в тщетности – вы не можете легко протестировать логику скоринга в изоляции; она неразрывно связана с процессами нормализации и сохранения. Изменение одного правила, скажем, добавление нового критерия скоринга, означает осторожное вторжение в сложную, взаимосвязанную структуру, рискуя вызвать непреднамеренные побочные эффекты где-то еще. А повторное использование логики нормализации? Это территория копипасты, ведущая к дублированию кода и головной боли при поддержке. Параллелизм, священный Грааль современных серверных систем, ощущается как нечто чуждое, когда всё так глубоко запутано.

Встречайте Pipeline: явные этапы, понятный поток

Основная идея Патерна Pipeline обманчиво проста: разбить сложный процесс на ряд дискретных, независимых этапов, с последовательным движением данных от одного к другому. Вместо одной гигантской функции, пытающейся сделать всё, у вас есть Scrape → Normalize → Score → Store. Каждый этап — это самодостаточный юнит, ответственный за одну конкретную задачу.

Преимущества здесь немедленны и глубоки. Читаемость взлетает до небес. Сама структура диктует поток операций. Тестирование становится проще простого — вы можете запускать отдельные этапы с моковыми данными и проверять их поведение в изоляции. Модификация или расширение пайплайна так же проста, как замена или добавление новых этапов, не затрагивая существующие компоненты. Повторное использование кода? Оно встроено. Хотите использовать логику нормализации где-то еще? Просто импортируйте модуль. А параллелизм? Он становится гораздо более управляемым, поскольку вы можете легче идентифицировать независимые этапы, которые можно запускать параллельно.

Сборка: гибкость через интерфейсы

Настоящее волшебство происходит, когда эти этапы связываются с использованием интерфейсов. Это секретный соус, который обеспечивает исключительную гибкость, предлагаемую Паттерном Pipeline. В примере с парсером вакансий обратите внимание, как структура Pipeline принимает зависимости, такие как scorer и jobService, через интерфейсы в своем конструкторе (NewPipeline).

type Pipeline struct {

scorer scoring.Scorer

jobService JobService

companyService CompanyService

logger *slog.Logger

}

func NewPipeline(

scorer scoring.Scorer,

jobService JobService,

companyService CompanyService,

logger *slog.Logger,

) *Pipeline {

return &Pipeline{

scorer: scorer,

jobService: jobService,

companyService: companyService,

logger: logger,

}

}

Это внедрение зависимостей означает, что сам Pipeline не заботится о том, как выполняется скоринг или где сохраняются вакансии, а только о том, что он получает объект, соответствующий ожидаемому интерфейсу. Метод Run() затем оркестрирует поток:

func (p *Pipeline) Run(ctx context.Context, scraper Scraper) error {

// 1. Scrape

rawJobs, err := scraper.Scrape(ctx)

if err != nil {

return fmt.Errorf("scraping %s: %w", scraper.Source(), err)

}

for _, rawJob := range rawJobs {

// 2. Normalize

normalizedJob, err := normalize.Normalize(rawJob)

if err != nil {

failed++

continue

}

// 3. Score

job.Score = p.scorer.Score(job)

// 4. Save

if err := p.jobService.Save(ctx, job); err != nil {

failed++

continue

}

saved++

}

return nil

}

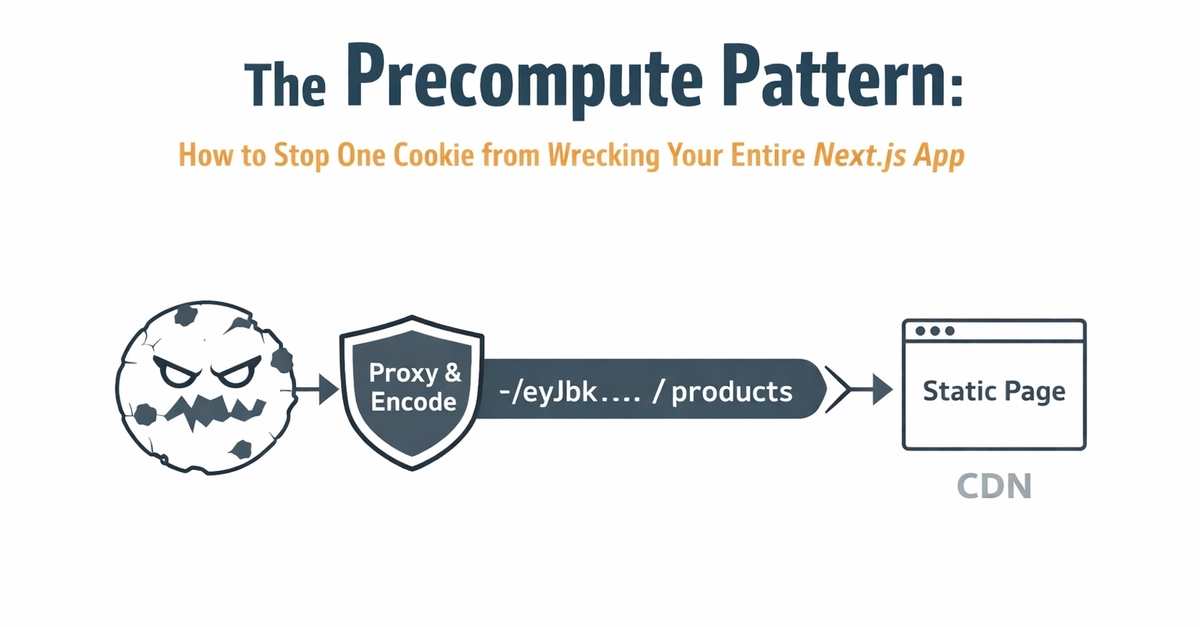

Это чистое разделение позволяет заменять целые компоненты, не изменяя основную логику пайплайна. Нужен другой парсер для новой доски вакансий? Внедрите новую реализацию Scraper. Хотите протестироваться с in-memory базой данных вместо PostgreSQL? Передайте реализацию InMemoryStore. Рассматриваете модель машинного обучения для скоринга? Просто предоставьте Scorer, реализующий эту логику.

Историческое эхо: революция сборочной линии

Эта модульность — не просто хитрость; она отражает фундаментальный сдвиг в промышленном производстве. Конвейер Генри Форда произвел революцию в производстве, разбив сложную задачу сборки автомобиля на ряд простых, повторяющихся шагов, выполняемых специализированными рабочими или машинами. Каждая станция выполняла одну работу, и продукт линейно перемещался от одной к другой. Результат? Беспрецедентная эффективность, стандартизация и масштабируемость. Паттерн Pipeline применяет этот же принцип к разработке программного обеспечения, превращая монолитные, трудноуправляемые кодовые базы в элегантные, эффективные и высокоадаптивные системы.

Итог: почему это важно для разработчиков

Для разработчиков внедрение Паттерна Pipeline означает написание кода, который не только более функционален, но и с ним приятнее работать. Это приводит к созданию систем, которые легче понимать, отлаживать и расширять. Статистика 47%, которую я упомянул ранее? Принимая этот паттерн, мы можем реально стремиться к значительному сокращению этой цифры, делая процесс разработки более гладким, а результирующее программное обеспечение — более надежным. Это явная победа для поддерживаемости, тестируемости и, в конечном итоге, для скорости, с которой мы можем внедрять инновации.

🧬 Связанные материалы

- Читать подробнее: CNCF передает Kusari ключи к безопасным облачным цепочкам поставок — бесплатно

- Читать подробнее: Уход Gallery-dl с GitHub: DMCA ударил по скреперу с открытым исходным кодом, Codeberg манит

Часто задаваемые вопросы

Что делает Паттерн Pipeline в Go?

Он структурирует Go-приложения, разбивая сложные процессы на серию независимых, последовательных этапов, что обеспечивает модульность, тестируемость и гибкость.

Подходит ли этот паттерн для всех Go-проектов?

Он особенно эффективен для обработки данных, ETL (Extract, Transform, Load), асинхронного выполнения задач и любых рабочих процессов, включающих несколько дискретных шагов, где модульность приносит пользу.

Как это улучшает тестирование?

Изолируя каждый этап процесса, вы можете писать модульные тесты для отдельных компонентов, не требуя настройки всей системы, что делает тестирование быстрее и целенаправленнее.