А поиск ускорения обучения ИИ-моделей — это просто изощрённая игра с цифрами и проводами? Мы задаёмся этим вопросом, потому что свежий прорыв от PyTorch и Nebius — это не просто срезание миллисекунд с времени обучения. Это погружение в то, как изменения в архитектуре числовой точности и межгПУ-коммуникации меняют экономику масштабного ИИ-разработки. Главная цифра? Невероятный прирост пропускной способности предобучения на 41% для гигантских DeepSeek-V3 Mixture-of-Experts (MoE) моделей на топовых GPU NVIDIA B200. Это не просто «быстрее»; это потенциальный сдвиг парадигмы.

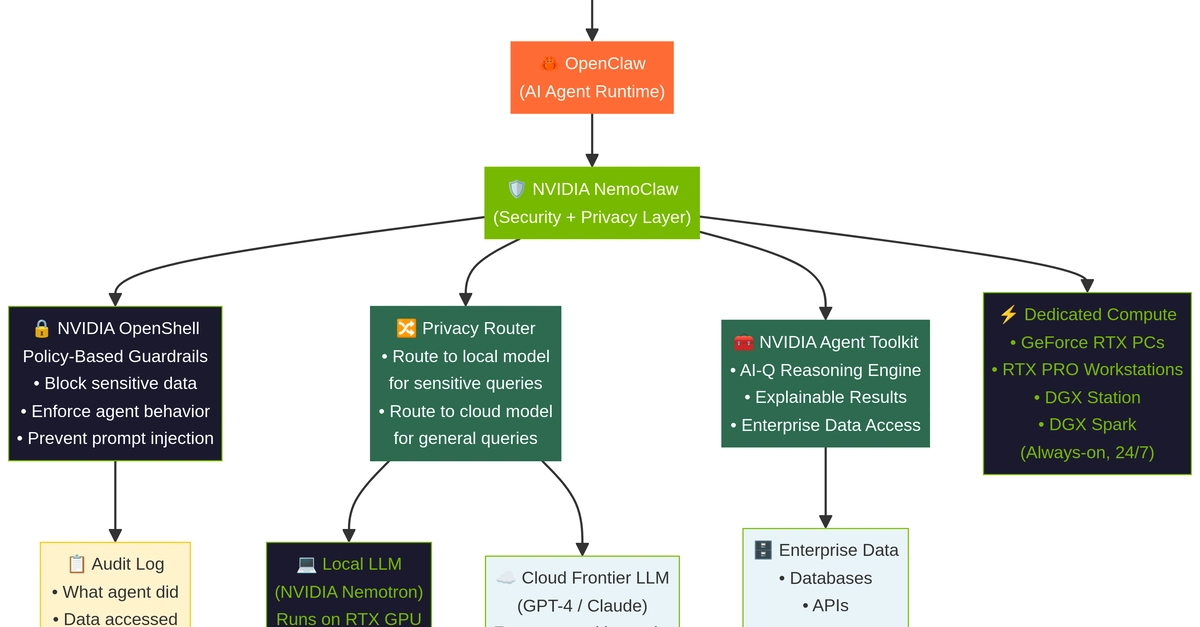

Откинем корпоративный лоск. Здесь оркестр низкоуровневой инженерии. Команда DeepSeek-V3 вместе с PyTorch и Nebius применила к своим монстрам с 16B и 671B параметров на кластере из 256 GPU две ортогональные, но взаимодополняющие оптимизации. Первая — MXFP8, специализированный вариант FP8 (8-битной арифметики с плавающей запятой), заточенный под тензорные ядра NVIDIA B200. Вторая — DeepEP, кастомная библиотека коммуникаций, которая разбирает узел проблемы: как MoE-модели тасуют тонны данных между GPU.

Двухсторонняя атака: MXFP8 и DeepEP

Главная засада при обучении MoE-моделей в масштабе — двойная. Во-первых, чистая вычислительная нагрузка. Эти модели динамически маршрутизируют данные к специализированным «экспертам», вызывая потоп матричных умножений (GEMM), которые могут завалить даже самое мощное железо. Архитектура Blackwell от NVIDIA с пятым поколением тензорных ядер нативно поддерживает MXFP8. Этот формат, в отличие от стандартного FP8, использует более тонкую градацию масштабирования, сохраняя числовую точность и выжимая пиковую теоретическую пропускную способность для ключевых GEMM. Цель проста: ускорить матан, не жертвуя точностью. Эксперименты подтверждают: MXFP8, особенно для групповых GEMM в экспертных слоях MoE, даёт солидный буст.

Вторая узкая горловина — и часто самая коварная для MoE — коммуникация. Каждый слой требует двух шагов «all-to-all»: разослать токены экспертам и собрать результаты. Поскольку маршрутизация токенов динамическая — модель решает на лету, — стандартные примитивы для предсказуемых потоков буксуют. Получается огромный затор, особенно при росте модели и кластера. DeepEP вмешивается, заменяя общие коллективные коммуникации на заточенные под железо ядра NVLink и RDMA. Ключ — минимум CPU, GPU общаются напрямую, что критично для таких переменных и объёмных трансферов.

«DeepEP заменяет стандартный all-to-all бэкенд на специализированные ядра NVLink и RDMA, минимизируя вовлечение CPU и позволяя GPU напрямую слать веса, — что снижает задержки».

По-настоящему впечатляет синергия. MXFP8 бьёт по вычислениям, DeepEP — по коммуникациям. Вместе они не суммируются, а умножаются. Полученные 41% прироста для 671B-модели — это не 32% от DeepEP плюс вклад MXFP8. Это кумулятивный эффект: весь пайплайн перестроен под эффективность.

За бенчмарками: реальное влияние

Это не демо для спецкластера. Последствия шире. Для компаний, строящих и обучающих огромные ИИ-модели — от фундаментальных LLM до генеративных систем, — каждый процент эффективности напрямую рубит расходы на вычисления и ускоряет итерации. Обучить 671B-модель — астрономическая задача. Срезать 41% времени обучения, энергопотребления и облачных счетов — значит сделать невозможное чуть реальнее.

Это ещё и сигнал зрелости экосистемы вокруг топового железа вроде B200. Сырой мощности мало; софт должен быть не проще. Инструменты вроде TorchAO (для MXFP8) и DeepEP показывают: open source-сообщество и провайдеры вроде Nebius строят инфраструктуру, чтобы выжать максимум из этих чипов. А полная воспроизводимость экспериментов добавляет доверия.

MXFP8 — будущее обучения MoE?

Результаты впечатляют, но скепсис не помешает. MXFP8 не портит сходимость на 16B-модели, но это mixed precision. Чёрт в деталях: стабильность и гарантии на сверхдлинных запусках. Мы видели, как агрессивное снижение точности рождает скрытые проблемы позже. Однако архитектура MXFP8 — Microscaling FP8 — и её интеграция через TorchAO явно заточены под минимизацию рисков, особенно для GEMM в MoE. Настоящий тест — масштабирование на большие модели и длительные тренинги.

Эксперимент подчёркивает ключевой выбор для MoE: баланс вычислений и коммуникаций. С ростом моделей коммуникации доминируют. Успех DeepEP говорит: спецядра, заточенные под железо, — не роскошь, а must-have для следующего поколения ИИ. Напоминание: оптимизировать кремний — полдела; софт и системный дизайн должны шагать в ногу.

Это не финал. Это начало главы, где кастомные оптимизации под архитектуры вроде MoE выходят на первый план. Эра «добрось ещё GPU» уступает нюансированной: умный софт и спецформаты дают то, чего brute force не потянет. Гонка за эффективным обучением ИИ в разгаре, и MXFP8 с DeepEP — лидеры пелотона.

🧬 Related Insights

- Read more: Flutter Deep Links Finally Click: Bridging Native Chaos with One Smart Service

- Read more: Daily Briefing: April 26, 2026

Frequently Asked Questions

What is MXFP8? MXFP8 (Microscaling FP8) is a low-precision numerical format that uses a shared exponent for smaller blocks of 32 elements, offering finer-grained scaling to preserve numerical fidelity while leveraging FP8 hardware for faster computations.

How does DeepEP improve communication? DeepEP replaces standard collective communication with optimized NVLink and RDMA kernels that allow GPUs to communicate more directly, reducing CPU involvement and latency, which is crucial for the dynamic all-to-all communication patterns in MoE models.

Will these optimizations work for all AI models? These specific optimizations, MXFP8 and DeepEP, are particularly beneficial for Mixture-of-Experts (MoE) models due to their heavy reliance on grouped GEMMs and dynamic all-to-all communication patterns. While the underlying principles of mixed precision and optimized communication are broadly applicable, the exact implementation details and gains may vary for different model architectures.