더 빠른 AI 모델 훈련 추구가 결국 숫자와 케이블의 정교한 게임일 뿐인가? PyTorch와 Nebius의 최신 성과를 보면 그렇게 느껴진다. 단순히 훈련 시간을 밀리초 단위로 줄이는 게 아니라, 수치 정밀도와 GPU 간 통신의 구조적 변화가 대규모 AI 개발 경제성을 근본적으로 바꿀 수 있다는 깊은 통찰이다. 핵심 숫자는? NVIDIA 최신 B200 GPU에서 거대 DeepSeek-V3 Mixture-of-Experts (MoE) 모델의 프리트레이닝 처리량이 무려 41% 향상된 거다. 이건 그냥 ‘훈련 빨라짐’이 아니라 패러다임 전환의 신호탄이다.

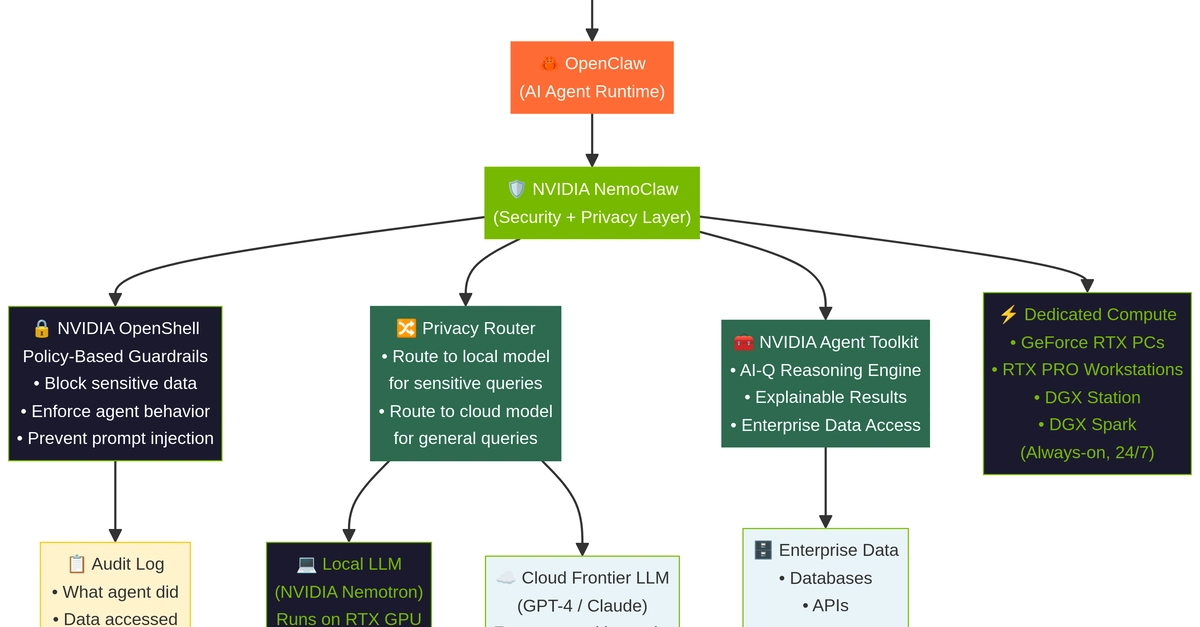

기업 광고 문구는 제쳐두자. 실제로는 저수준 엔지니어링의 교향곡이다. DeepSeek-V3 팀이 PyTorch, Nebius와 함께 16B·671B 파라미터 MoE 거대 모델을 256 GPU 클러스터에서 돌리며 두 가지 상호보완적 최적화 기술을 동원했다. 첫째는 NVIDIA B200 텐서 코어를 활용한 FP8(8비트 부동소수점) 변형인 MXFP8. 둘째는 MoE 모델이 GPU 간에 어마어마한 데이터를 주고받는 문제를 푸는 맞춤형 통신 라이브러리 DeepEP다.

MXFP8·DeepEP의 양날 공격

대규모 MoE 모델 훈련의 핵심 고난은 두 가지다. 첫째, 엄청난 계산 부하. 이 모델들은 데이터를 동적으로 전문 ‘전문가’ 네트워크로 라우팅해 매트릭스 곱셈(GEMM) 홍수를 일으키는데, 최강 하드웨어조차 버거워한다. NVIDIA Blackwell 아키텍처의 5세대 텐서 코어는 MXFP8을 네이티브 지원한다. 표준 FP8과 달리 미세한 스케일링으로 수치 정확성을 유지하면서 GEMM의 이론 최대 처리량을 뽑아낸다. 목표는 간단하다: 정확도 손상 없이 수학 연산을 더 빠르게.

실험이 증명하듯 MXFP8은 특히 MoE 전문가 레이어의 그룹 GEMM에서 큰 속도 향상을 가져온다.

둘째, MoE에서 더 골치 아픈 통신 병목. MoE 모델 각 레이어는 토큰을 지정된 전문가에게 보내고 결과를 모으는 두 번의 ‘all-to-all’ 통신 단계를 거친다. 토큰 라우팅이 런타임에 모델이 결정하는 동적이라 예측 가능한 데이터 흐름을 전제로 한 표준 통신이 고전한다. 모델과 클러스터 크기가 커질수록 병목이 극심해진다. DeepEP이 등장해 범용 집단 통신 대신 NVLink·RDMA 커널로 최적화했다. CPU 관여를 최소화해 GPU가 직접 데이터를 주고받게 하니, 변동적 대량 전송에 딱이다.

“DeepEP은 표준 all-to-all 백엔드를 대체해 NVLink·RDMA 커널로 CPU 관여를 줄인다. GPU가 직접 가중치를 보내 지연을 낮춘다.”

진짜 매력은 시너지다. MXFP8은 계산 쪽을, DeepEP은 통신 쪽을 공략한다. 따로 놀 것 같던 이 둘이 합쳐지니 단순 합이 아니라 곱셈 효과. 671B 모델의 41% 향상은 DeepEP의 32%에 MXFP8을 더한 게 아니라 전체 파이프라인이 재설계된 결과다.

벤치마크 너머 실전 파급력

이건 특수 GPU 클러스터 쇼케이스가 아니다. 파운데이션 모델이나 LLM, 복잡한 생성 시스템을 훈련하는 조직에겐 효율 1%포인트가 계산 비용 절감과 빠른 반복으로 직결된다. 671B 파라미터 모델 훈련은 천문학적 프로젝트다. 훈련 시간 41% 줄이면 에너지와 클라우드 비용도 그만큼 줄어 불가능이 조금 더 가능해진다.

B200 같은 최신 하드웨어 생태계가 성숙해졌다는 신호다. 원시 성능만으로는 부족하고, 소프트웨어 스택도 정교해야 한다. TorchAO(MXFP8용)와 DeepEP 같은 PyTorch 네이티브 도구가 오픈소스 커뮤니티와 Nebius가 이 칩의 잠재력을 풀어내는 인프라를 짓고 있음을 보여준다. 실험이 모두 재현 가능하니 신뢰도 업.

MXFP8이 MoE 훈련의 미래인가?

결과는 인상적이지만 냉정해야 한다. MXFP8은 16B 모델에서 수렴 저하 없이 잘 됐지만, 혼합 정밀도 형식이다. 극장기간 훈련에서 수치 안정성과 수렴 보장이 관건. 정밀도 강제 줄이면 나중에 미묘하지만 치명적 문제가 생기는 사례가 많다. 다만 MXFP8(Microscaling FP8)과 TorchAO 통합은 MoE GEMM 특성에 맞춰 위험을 줄인 듯하다. 진짜 시험대는 더 큰 모델과 장기 훈련이다.

이 실험은 MoE 아키텍처의 핵심 선택을 드러낸다: 계산과 통신 균형. 모델이 커질수록 통신 오버헤드가 지배적이다. DeepEP 성공은 하드웨어 인식 통신 커널이 필수임을 말한다. 실리콘 최적화는 절반, 소프트웨어와 시스템 설계가 발맞춰야 한다는 거다.

이게 이야기의 끝이 아니다. MoE 같은 특정 아키텍처 맞춤 최적화가 주류가 되는 새 장의 시작이다. GPU 더 때려박는 시대가 물러나고, 영리한 소프트웨어와 특화 수치 형식이 brute force를 뛰어넘는 세대로 넘어간다. 효율적 AI 훈련 경쟁이 치열해지고, MXFP8·DeepEP 같은 도구가 선두 주자다.

🧬 Related Insights

- Read more: Flutter Deep Links Finally Click: Bridging Native Chaos with One Smart Service

- Read more: Daily Briefing: April 26, 2026

Frequently Asked Questions

What is MXFP8? MXFP8 (Microscaling FP8)은 32개 요소 블록에 공유 지수를 써서 미세 스케일링으로 수치 충실도를 유지하면서 FP8 하드웨어로 빠른 계산을 하는 저정밀도 형식이다.

How does DeepEP improve communication? DeepEP은 표준 집단 통신을 최적화된 NVLink·RDMA 커널로 바꿔 GPU 직접 통신으로 CPU 관여와 지연을 줄인다. MoE의 동적 all-to-all 패턴에 핵심이다.

Will these optimizations work for all AI models? MXFP8과 DeepEP은 그룹 GEMM과 동적 all-to-all에 의존하는 MoE 모델에 특히 유리하다. 혼합 정밀도와 최적 통신 원리는 널리 적용되지만, 모델별 구현과 효과는 다를 수 있다.