いいか、俺はこのシリコンバレーという業界を、認めたくないほど何度も見てきた。流行り廃り、会社が急上昇しては、驚くべきことに、まともなビジネスモデルがなかったばかりに消え去る様も。だから、「TurboQuant: A first-principles walkthrough」なんてタイトルの論文を目にすると、俺のBSセンサーはフル稼働する。ベクトルだとか量子化だとか、そういう言葉を並べただけで感心するわけにはいかない。なぜこれが重要なのか、そしてもっと重要なこととして、一体誰がここで金儲けをしているのかを知りたいのだ。あるスタートアップがまたVCからの資金調達に成功するためのものなのか、それとも開発者やユーザーにとって実際に事態を動かすようなものなのか?

誰が何を掴んでいるのか?

結論から話そう。これは本質的には、巨大で扱いにくいデータのかたまり――お気に入りのAIモデルが吐き出すあの巨大な埋め込み(embedding)を想像してほしい――を、保存や処理がしやすいように圧縮する話だ。元の論文では、ベクトルを「原点からの矢印」と説明し、「誤差は推測と真実の距離」だと述べている。どれも結構。2Dや3Dのグリッドに点を合わせるきれいな図、確かに。デジタルレゴブロックみたいだ。だが、ここが肝心なのだ。AIの文脈でこれを語るとき、我々はしばしば、モデルを圧縮してスマホで動かせるようにしたり、ネットワークで送るデータを減らしたり、あのうんざりするほど遅い最近傍探索(nearest-neighbor search)をほんの少し速くしたりすることを意味している。通常、金になるのはそこだ――クラウドの請求額を下げる、あるいは新しい製品カテゴリーを可能にする効率化だ。

論文自体は、いくつかの基礎的な概念を提示している。平均二乗誤差(MSE)で推測がどれだけ外れているかを測ること、量のモーメント(基本的に統計的な指紋)、そして不偏推定量(unbiased estimator)という考え方。これは、圧縮されたデータが元のデータを reasonably faithful に表現していることを保証するための、多くの数学の集約だ。

誤差とは、推測と真実の距離である。推測を符号付き誤差で採点すると、正の誤差と負の誤差が相殺されるため、スコアは誤差を罰しない。二乗することは、すべての誤差を正の数としてカウントさせ、小さな誤差よりも大きな誤差により大きな罰を与える。

あの二乗する部分?あれが、大きな間違いに対して彼らを余計に苛立たせる部分だ。AIにおいて、大きな間違いとは、チャットボットがナンセンスをまき散らすことから、あなたが犬の餌しか検索したことがないのに、猫のセーターをおすすめするレコメンデーションエンジンまで、何でもあり得る。だから、その二乗誤差を最小化することは、つまり、良いことだ。それは、AIが本来覚えるべきことを覚えているか、それとも単に…重要なことをすべて忘れているかの違いだ。

バイアス・バリアンスのトレードオフ、それとも単なるバズワード?

次に推定量(estimator)の話になる。バイアスとバリアンスだ。アーチェリー(弓道)だと考えてみてくれ。バイアスとは、矢がすべて一箇所に集まっていても、常に的の中心から10フィート左に着弾するようなものだ。バリアンスとは、矢が的のあちこちに散らばっていても、その平均位置が的の中心にあるようなものだ。ほとんどの場合、これらの企業は両方を削減しようとしている。論文では、これらの失敗モードを示す「的」が描かれている。素晴らしい。だが、またしても、誰が利益を得るのか?もし TurboQuant がこれらのベクトル表現におけるバイアスとバリアンスを本当に削減するなら、それはAIモデルがより正確で、より一貫性のあるものになることを意味する。それはモデル開発者にとって間違いなく勝利だ。だが、本当の報酬は?その改善された正確さと一貫性が、人々がお金を払う意思のある、より良いユーザー体験に繋がるとき、あるいは、効率化によって企業がより大きく、より複雑なモデルを低コストで実行できるようになるときだ。

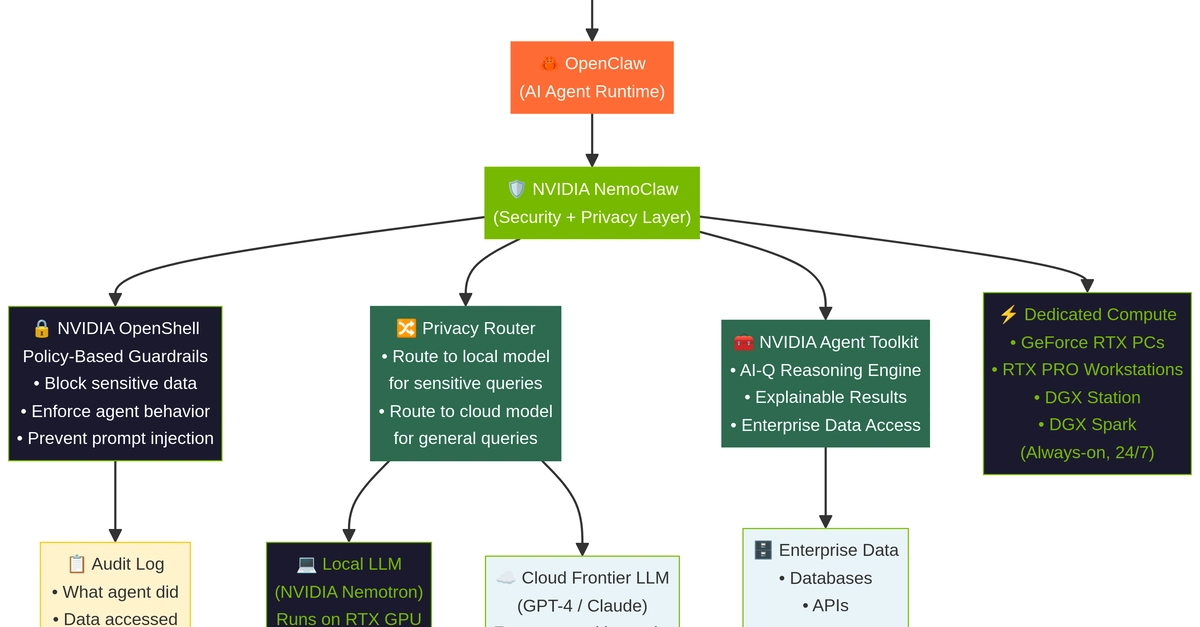

俺の勘では、これはAIモデルをより小さく、より速く、より安く実行するためのものだ。オンデバイスAI、あるいは地下室にスーパーコンピュータを必要としないAIを想像してほしい。そこが多くのビジネスにとっての現実だ。

これも高次元の専門用語か?

俺の皮肉な目を引くのは、「高次元集中(high-dimensional concentration)」という言及だ。平易な言葉で言えば、超高次元(例えば、OpenAIの埋め込みで言われる1536次元)では、物事は奇妙になるということだ。本来近いべき点が遠く離れて見えたり、その逆だったりする。標準的な直感が通用しなくなるのだ。これらの高次元ベクトルを限られた「レベル」や点に圧縮するプロセスである量子化は、本当の課題になり得る。もしあなたの量子化手法がこの高次元の奇妙さを考慮していなければ、圧縮された表現が実質的に役に立たないものになってしまう可能性がある。

論文は、TurboQuantがこれに対処する方法を持っていることを示唆している。だが、問題は残る――既存の手法よりも意味のある改善を提供しているのか?新しい技術を導入する労力に見合うだけの顕著な進歩なのか、それとも単に大げさに装われた、またしても段階的な進歩に過ぎないのか?我々は、月を約束しながら、ただ少しばかり乗り心地の良いライドしか提供しない新しい圧縮アルゴリズムで、これが展開されるのを何度も見てきた。真のテストは、論文の優雅さではない。それは、実世界でのパフォーマンスと、それを採用する経済的インセンティブなのだ。

技術業界が目まぐるしいペースでイノベーション(と投資家向けピッチ)を生み出しているのを、俺の立場から見ていると、TurboQuantは技術的に興味深い作品に見える。AIデータをより管理しやすくするという、実際の問題に取り組んでいる。しかし、「first-principles」と「walkthrough」は、「非常に学術的で、まだ実運用には程遠い」の隠語でもあるかもしれない。これが実際のデプロイされたシステムに登場し、コストを削減し、あるいはこれまで実現不可能だった全く新しいAIアプリケーションを可能にしているのを見るまで、俺は慎重に懐疑的でいるだろう。究極の問いは「数学はどれほど賢いか?」ではなく、「これは誰かに、どこかで、いくらの金をもたらすのか?」ということだ。そして、それが、私の友人たち、シリコンバレーにおける最も古い問いなのだ。