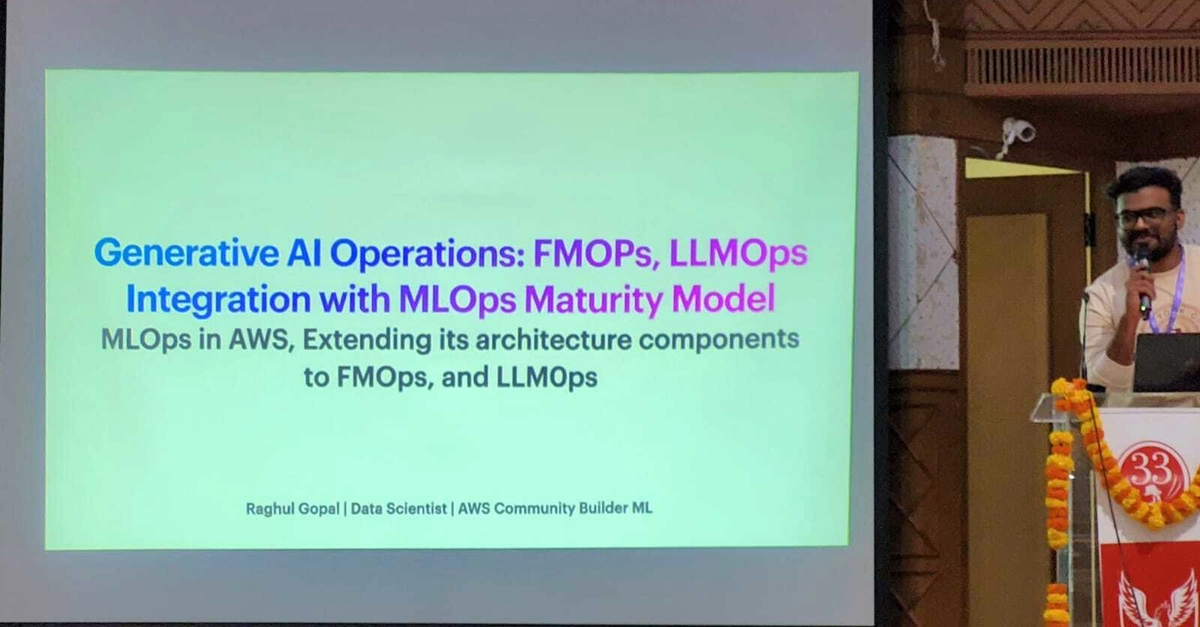

От MLOps к LLMOps: почему команды AWS всё ещё спотыкаются на production AI

AWS даёт вам инструменты. Но используете ли вы их правильно на production? Честный взгляд на то, почему AI-команды игнорируют операционные основы.

⚡ Key Takeaways

- Большинство команд относятся к production AI как к ноутбучному экспименту, а не развёрнутой системе — что приводит к молчаливым отказам, дрейфу данных и перерасходу бюджета. 𝕏

- MLOps (традиционные модели), FMOps (foundation models) и LLMOps (языковые модели) следуют одним и тем же операционным принципам, но в разных масштабах и с разными сценариями отказов. 𝕏

- Инструменты AWS существуют, но зрелость достигается дисциплиной в процессах (версионирование, мониторинг, approval gate'ы), а не просто покупкой больше сервисов. 𝕏

- LLMOps привносит уникальные вызовы: обнаружение галлюцинаций, отслеживание стоимости токенов и дрейф промптов, которых традиционный MLOps не решает. 𝕏

Worth sharing?

Get the best Open Source stories of the week in your inbox — no noise, no spam.

Originally reported by Dev.to