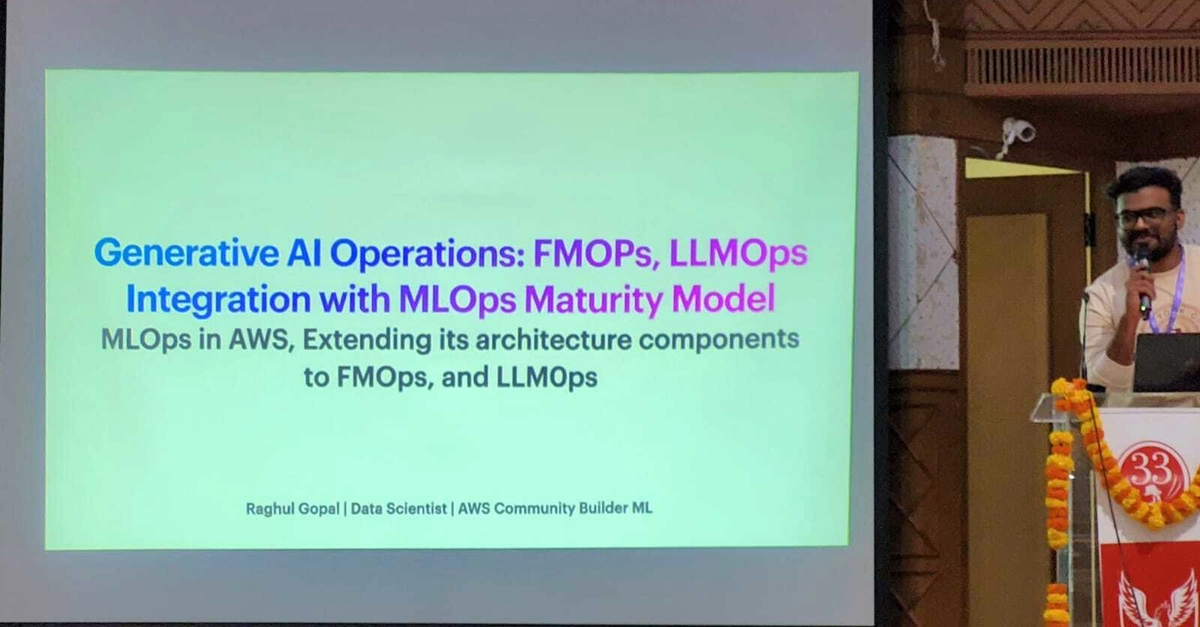

De MLOps para LLMOps: Por Que Times da AWS Ainda Estão Patinando em IA Produtiva

A AWS te dá as ferramentas. Mas você tá realmente usando elas certo em produção? Uma análise crua de por que a maioria dos times de IA pula os fundamentos operacionais.

⚡ Key Takeaways

- A maioria dos times trata IA em produção como um experimento de notebook, não um sistema de verdade — gerando falhas silenciosas, drift de dados e estouros de orçamento. 𝕏

- MLOps (modelos tradicionais), FMOps (foundation models) e LLMOps (modelos de linguagem) seguem os mesmos princípios operacionais mas em escalas diferentes e com modos de falha distintos. 𝕏

- As ferramentas da AWS existem, mas maturidade acontece através de disciplina de processo (versionamento, monitoramento, gates de aprovação), não só comprando mais serviços. 𝕏

- LLMOps adiciona desafios únicos: detecção de alucinação, rastreamento de custo de tokens e prompt drift que MLOps tradicional não tem. 𝕏

Worth sharing?

Get the best Open Source stories of the week in your inbox — no noise, no spam.

Originally reported by Dev.to