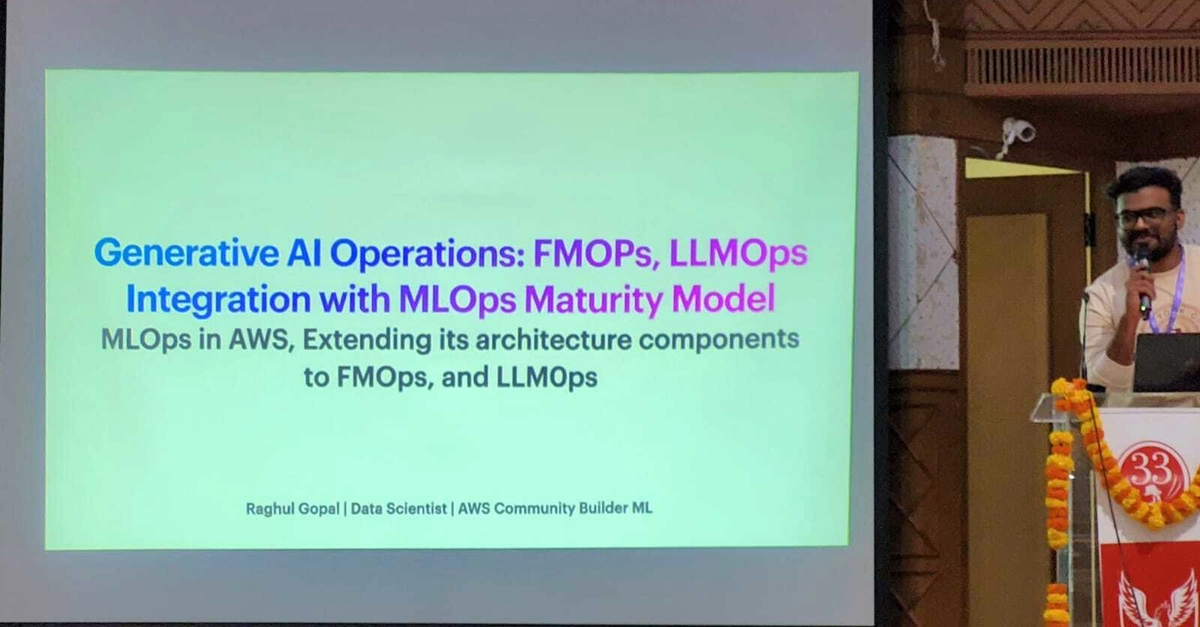

MLOps에서 LLMOps로: AWS 팀들이 여전히 실전 AI에서 헤매는 이유

AWS가 도구는 줄 수 있다. 하지만 실전에서 제대로 쓰고 있는가? AI 팀들이 운영의 기본을 건너뛰는 이유를 솔직하게 짚어본다.

⚡ Key Takeaways

- 대부분의 팀이 실전 AI를 배포된 시스템이 아닌 노트북 실험처럼 다루고 있다. 그 결과 조용한 실패, 데이터 표류, 비용 폭증이 생긴다. 𝕏

- MLOps(기존 모델), FMOps(파운데이션 모델), LLMOps(언어 모델)는 같은 운영 원칙을 따르지만 규모와 실패 방식이 다르다. 𝕏

- AWS 도구는 있지만, 성숙도는 더 많은 서비스를 사는 것이 아니라 프로세스 규율(버전 관리, 모니터링, 승인 게이트)로 온다. 𝕏

- LLMOps는 독특한 도전을 더한다. 할루시네이션 감지, 토큰 비용 추적, 프롬프트 표류 같은 기존 MLOps가 다루지 않는 문제들이다. 𝕏

Worth sharing?

Get the best Open Source stories of the week in your inbox — no noise, no spam.

Originally reported by Dev.to