API 비용 하루 10달러를 날렸다—로컬 모델로 0원 만드는 법

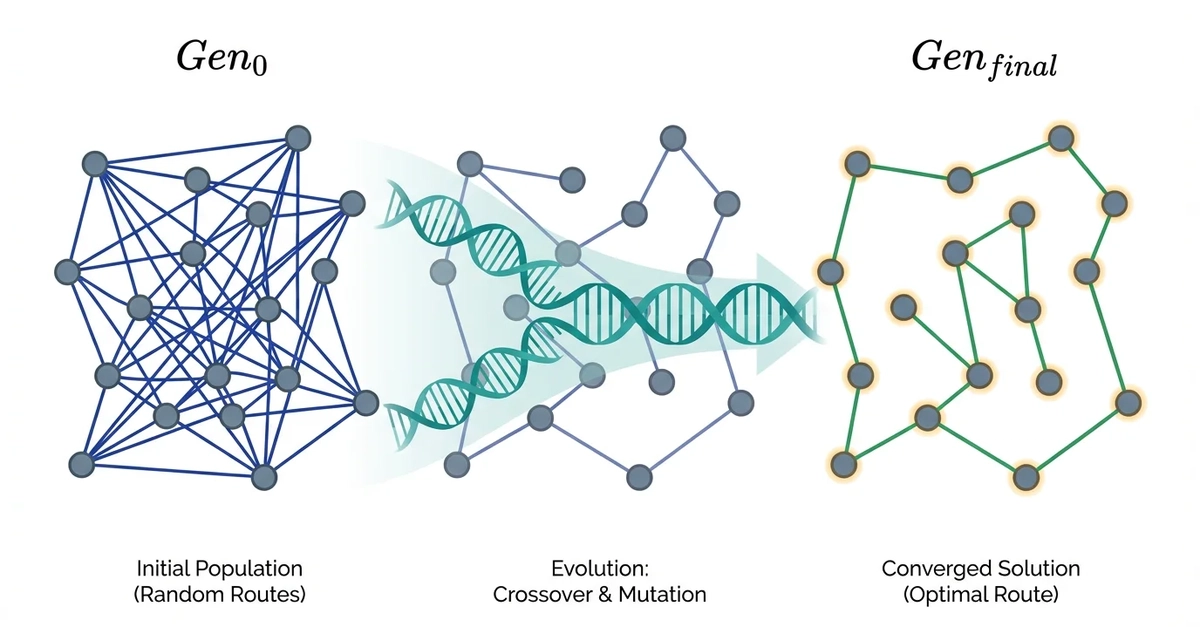

한 개발자가 RTX 3070 Ti 노트북에서 Gemma 4를 로컬로 실행해 하루 10달러짜리 클라우드 AI API 비용을 날렸다. 비결은 간단한 작업은 무료 로컬 모델로 처리하고, 복잡한 추론이 필요한 작업만 비싼 API에 넘기는 투 티어 시스템이었다.

⚡ Key Takeaways

Worth sharing?

Get the best Open Source stories of the week in your inbox — no noise, no spam.

Originally reported by Dev.to