Perché Qwen3.5:9B Demolisce i Modelli Più Grandi sulla Tua RTX 5070 Ti (E Perché Dovresti Preoccupartene)

Ho passato settimane a fare benchmark di modelli linguistici locali sulla mia RTX 5070 Ti. Il risultato? Un modello da nove miliardi di parametri di Alibaba ha demolito competitor ben più grandi—e non è perché più grande significa sempre meglio. Ecco cosa ho scoperto.

⚡ Key Takeaways

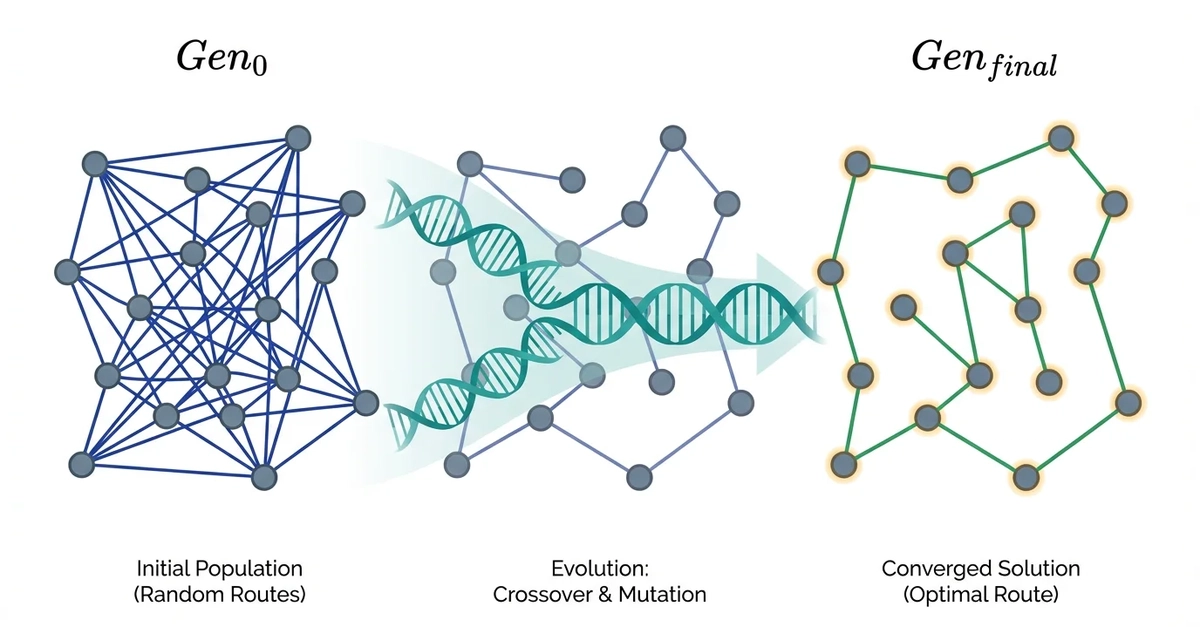

- Il numero di parametri è una metrica da vetrina—l'architettura del tool calling strutturato e l'efficienza della VRAM contano molto di più per gli agenti locali 𝕏

- Qwen3.5:9B ha superato competitor più grandi (Gemma 4, modelli da 27B) su task di agente nel mondo reale attraverso 18 test, nonostante avesse meno parametri 𝕏

- La VRAM è il vincolo reale su hardware consumer; il supporto nativo del tool calling + quantizzazione Q4_K_M eliminano l'overhead di parsing 𝕏

Worth sharing?

Get the best Open Source stories of the week in your inbox — no noise, no spam.

Originally reported by Dev.to