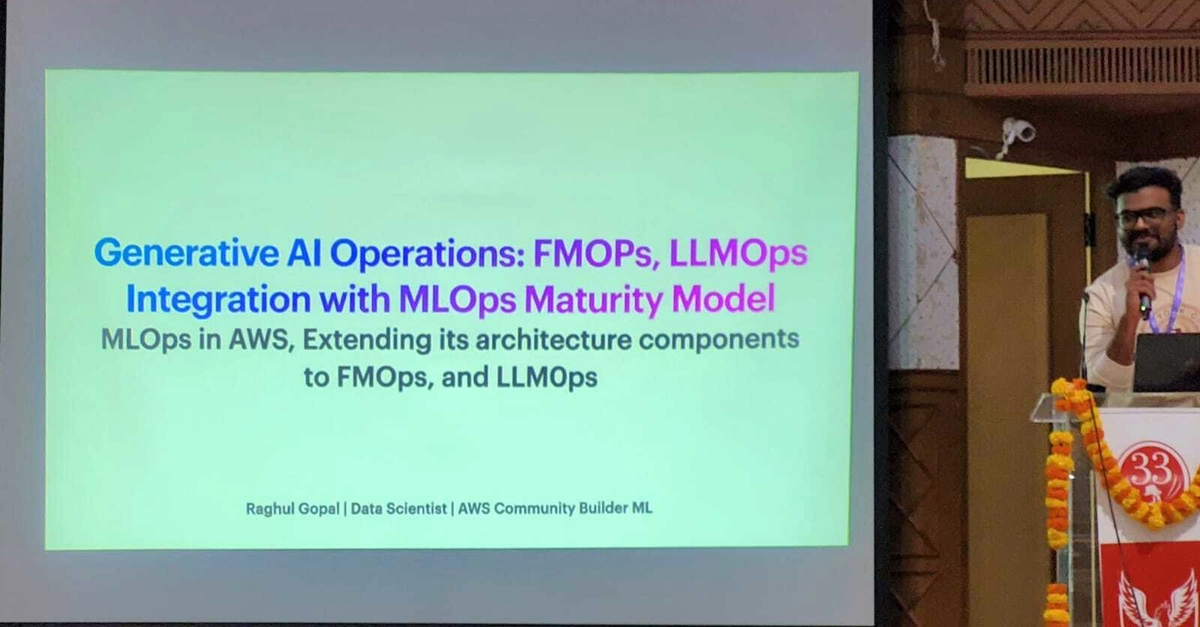

Da MLOps a LLMOps: Perché i Team AWS Faticano Ancora a Mandare in Produzione l'AI

AWS ti dà gli strumenti. Ma li stai usando davvero bene in produzione? Uno sguardo senza filtri a perché la maggior parte dei team salta i fondamentali operativi.

⚡ Key Takeaways

- La maggior parte dei team tratta l'AI in produzione come un esperimento su laptop, non come un sistema distribuito—causando fallimenti silenziosi, drift dei dati e overrun di costi. 𝕏

- MLOps (modelli tradizionali), FMOps (foundation model), e LLMOps (modelli linguistici) seguono gli stessi principi operativi ma a scale diverse e con modalità di fallimento diverse. 𝕏

- Gli strumenti AWS esistono, ma la maturità arriva attraverso disciplina di processo (versionamento, monitoring, gate di approvazione), non solo comprando più servizi. 𝕏

- LLMOps aggiunge sfide uniche: rilevamento delle allucinazioni, tracciamento dei costi dei token, e prompt drift che MLOps tradizionale non affronta. 𝕏

Worth sharing?

Get the best Open Source stories of the week in your inbox — no noise, no spam.

Originally reported by Dev.to