De MLOps à LLMOps : pourquoi les équipes AWS pataugent toujours en production

AWS vous donne les outils. Mais les utilisez-vous vraiment correctement en production ? Un regard sans détour sur les raisons pour lesquelles la plupart des équipes IA omettent les fondamentaux opérationnels.

⚡ Key Takeaways

- La plupart des équipes traitent la IA en production comme une expérience sur laptop, pas comme un système déployé — causant des défaillances silencieuses, des dérives de données et des dépassements de budget. 𝕏

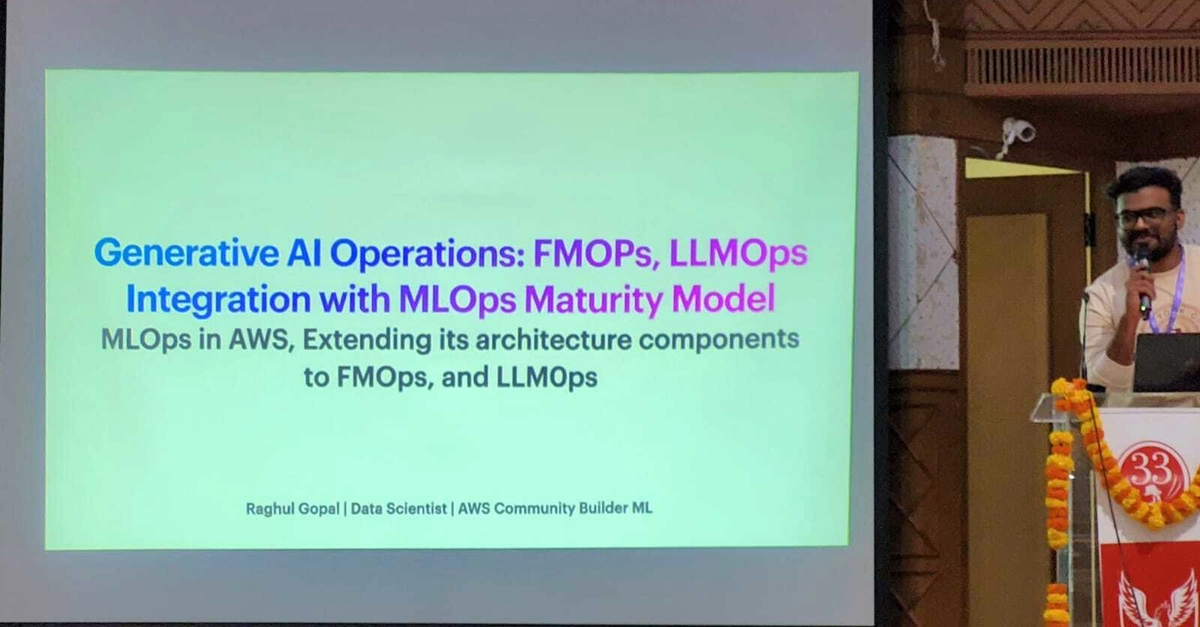

- MLOps (modèles traditionnels), FMOps (foundation models) et LLMOps (grand modèles de langage) suivent les mêmes principes opérationnels mais à des échelles différentes et avec des modes de défaillance différents. 𝕏

- Les outils AWS existent, mais la maturité se construit par la discipline des processus (versioning, monitoring, portes d'approbation), pas juste en achetant plus de services. 𝕏

- LLMOps ajoute des défis uniques : détection des hallucinations, tracking des coûts en tokens et dérive des prompts que MLOps traditionnel n'a pas. 𝕏

Worth sharing?

Get the best Open Source stories of the week in your inbox — no noise, no spam.

Originally reported by Dev.to