Por Qué Qwen3.5:9B Destroza a Modelos Más Grandes en tu RTX 5070 Ti (Y Por Qué Importa)

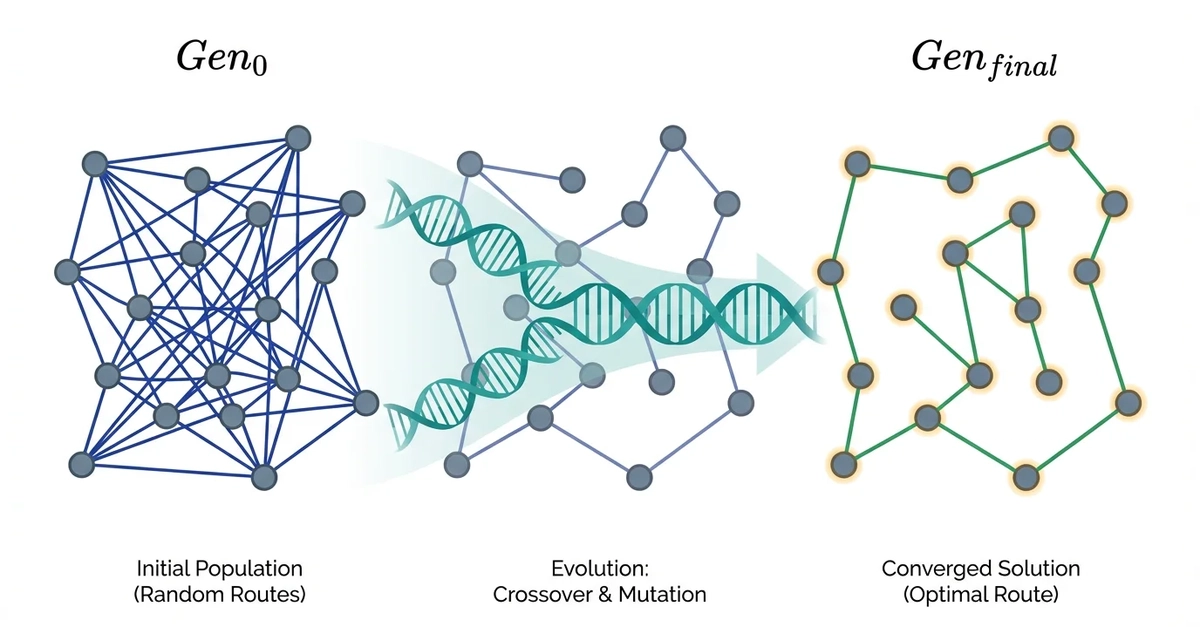

Pasé semanas haciendo benchmark de modelos de lenguaje locales en una RTX 5070 Ti. ¿El resultado? Un modelo de nueve mil millones de parámetros de Alibaba arrasó con la competencia más grande, y no es porque más siempre sea mejor. Esto es lo que descubrí.

⚡ Key Takeaways

- El conteo de parámetros es una métrica de vanidad—la arquitectura de tool calling estructurado y eficiencia de VRAM importan más para agentes locales 𝕏

- Qwen3.5:9B superó competidores más grandes (Gemma 4, modelos de 27B) en tareas reales de agentes en 18 tests, a pesar de tener menos parámetros 𝕏

- VRAM es la restricción real en hardware de consumidor; soporte nativo de tool calling + cuantización Q4_K_M elimina overhead de parsing 𝕏

Worth sharing?

Get the best Open Source stories of the week in your inbox — no noise, no spam.

Originally reported by Dev.to