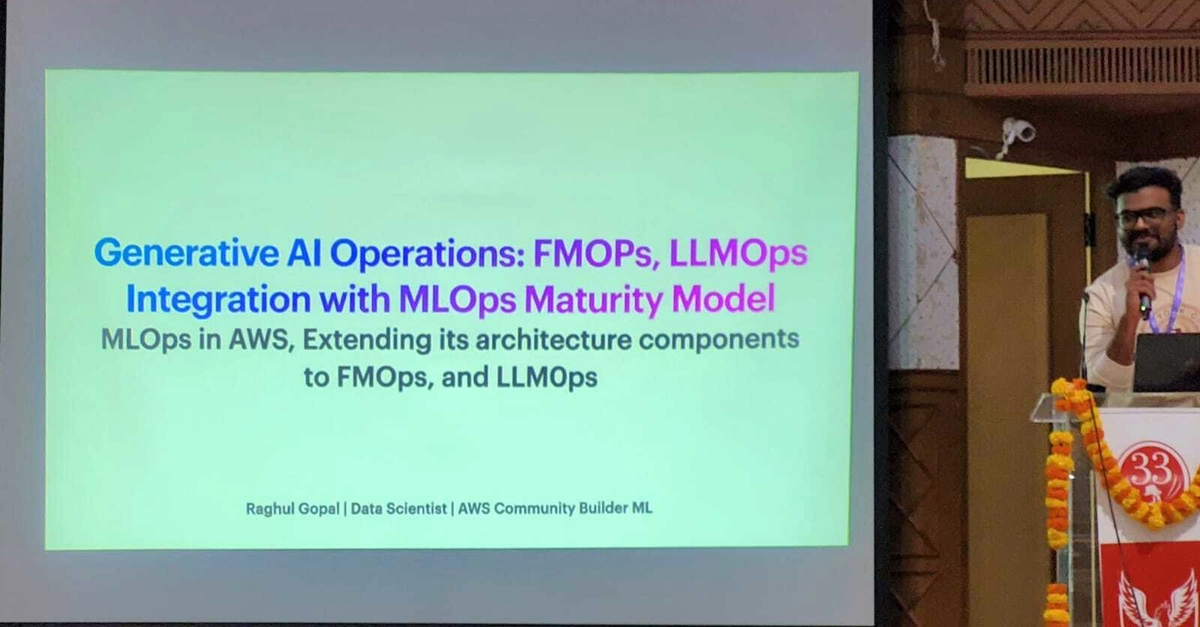

De MLOps a LLMOps: Por qué los equipos de AWS aún improvisan en producción

AWS te da las herramientas. ¿Pero las estás usando realmente bien en producción? Una mirada sin tapujos a por qué la mayoría de equipos de IA saltan los fundamentos operacionales.

⚡ Key Takeaways

- La mayoría de equipos trata la IA en producción como un experimento de laptop, no un sistema desplegado—causando fallas silenciosas, drift de datos y sobrecostos. 𝕏

- MLOps (modelos tradicionales), FMOps (foundation models) y LLMOps (modelos de lenguaje) siguen los mismos principios operacionales pero a diferentes escalas y modos de fallo. 𝕏

- Las herramientas de AWS existen, pero la madurez ocurre mediante disciplina de proceso (versionado, monitoreo, approval gates), no solo comprando más servicios. 𝕏

- LLMOps agrega desafíos únicos: detección de alucinaciones, rastreo de costos de tokens y drift de prompts que MLOps tradicional no aborda. 𝕏

Worth sharing?

Get the best Open Source stories of the week in your inbox — no noise, no spam.

Originally reported by Dev.to