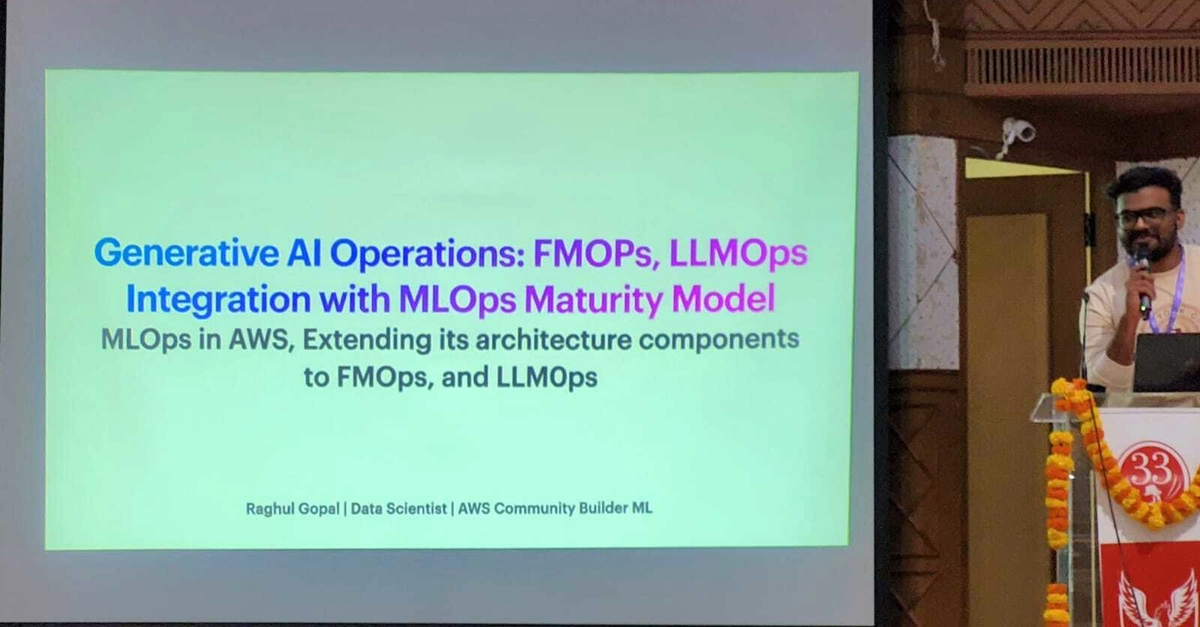

Von MLOps zu LLMOps: Warum AWS-Teams immer noch bei Production AI scheitern

AWS gibt dir die Tools. Aber nutzt du sie wirklich richtig in der Production? Ein ehrlicher Blick darauf, warum die meisten AI-Teams die operativen Grundlagen ignorieren.

⚡ Key Takeaways

- Die meisten Teams behandeln Production AI wie ein Laptop-Experiment, nicht wie ein deployed System – mit stillen Fehlern, Daten-Drift und Kostenüberläufern. 𝕏

- MLOps (traditionelle Modelle), FMOps (Foundation Models) und LLMOps (Sprachmodelle) folgen denselben Operationsprinzipien, aber in unterschiedlichen Maßstäben und mit unterschiedlichen Fehlermodi. 𝕏

- AWS-Tools existieren, aber Reife entsteht durch Prozess-Disziplin (Versionierung, Monitoring, Approval-Gates), nicht durchs Kaufen von mehr Services. 𝕏

- LLMOps bringt einzigartige Herausforderungen: Halluzinations-Erkennung, Token-Kosten-Tracking und Prompt-Drift, die traditionelle MLOps nicht hat. 𝕏

Worth sharing?

Get the best Open Source stories of the week in your inbox — no noise, no spam.

Originally reported by Dev.to