Mit einem kostenlosen lokalen Modell sparte ich $10 pro Tag an API-Kosten – so geht's

Ein Entwickler sparte sich $10 täglich an Cloud-AI-APIs, indem er Gemma 4 lokal auf einem RTX 3070 Ti Laptop laufen ließ. Das Geheimnis: ein zweistufiges System, das einfache Aufgaben an das kostenlose lokale Modell leitet und teure APIs nur für echte komplexe Probleme nutzt.

⚡ Key Takeaways

- Gemma 4 8B läuft auf Consumer-Gaming-Laptops (RTX 3070 Ti) mit partiellem VRAM-Offload und generiert 19–27 Token pro Sekunde für Klassifizierungs- und Extraktionsaufgaben 𝕏

- Thinking-Mode deaktivieren (think=false) liefert 4,7–7,7x Speedup bei strukturierter Arbeit ohne Qualitätsverlust – lokales Reasoning ist unnötiger Overhead bei Klassifizierung 𝕏

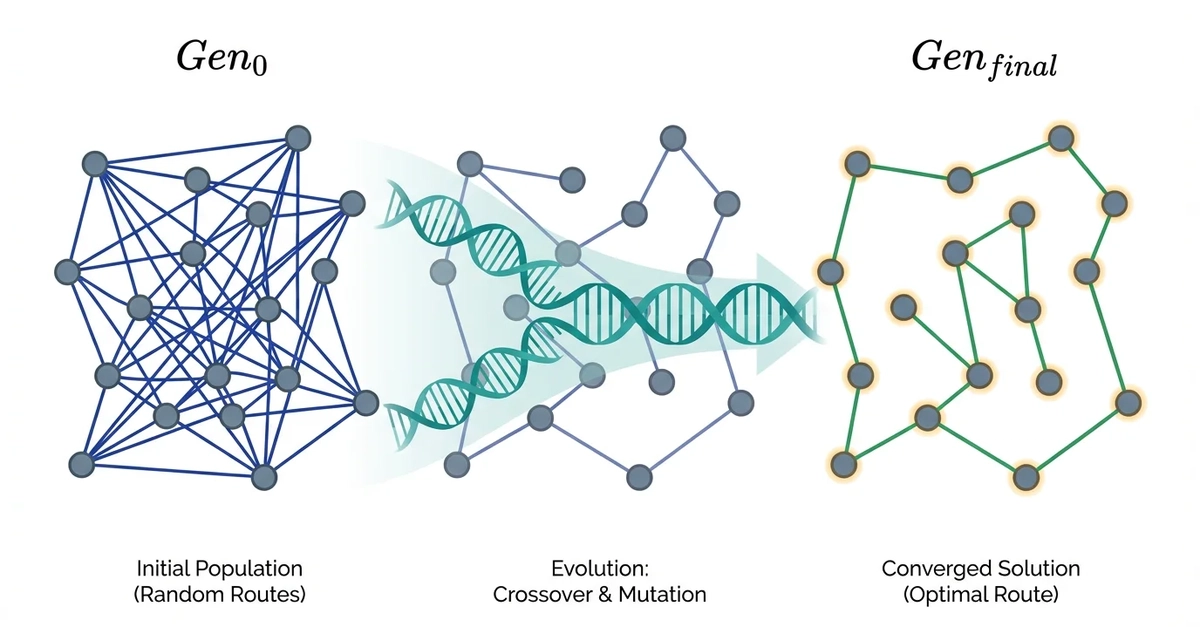

- Eine zweistufige Architektur (lokales Modell für Routing/Klassifizierung, Cloud-APIs für komplexes Reasoning) senkt $10/Tag API-Kosten bei besserer Latenz und System-Responsiveness 𝕏

Worth sharing?

Get the best Open Source stories of the week in your inbox — no noise, no spam.

Originally reported by Dev.to